La inteligencia artificial transparente mejora la evaluación de la agresividad del cáncer de próstata

La IA habla el lenguaje de los patólogos

Anuncios

Hasta ahora, la agresividad del cáncer de próstata se evaluaba principalmente mediante el sistema de clasificación de Gleason, un análisis muy subjetivo del tejido canceroso en un laboratorio de patología. Un equipo internacional de investigación dirigido por el Centro Alemán de Investigación Oncológica (DKFZ) ha desarrollado ahora un novedoso modelo de IA explicable que pretende que el diagnóstico del cáncer de próstata sea más transparente y menos susceptible de error.

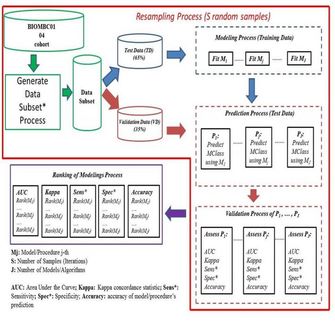

"Los modelos de IA anteriores pueden hacer predicciones sobre las puntuaciones de Gleason, pero a menudo no ofrecen una explicación comprensible, lo que limita su aceptación clínica", explica Titus Brinker, del DKFZ. El nuevo sistema prescinde de explicaciones retrospectivas y se basa directamente en descripciones de la patología. Para ello, expertos internacionales anotaron 1.015 muestras de tejido con explicaciones detalladas.

El estudio, en el que participaron 54 patólogos de diez países, presenta una de las colecciones más completas de anotaciones de tejidos basadas en explicaciones. Como resultado, el equipo de Heidelberg presenta "GleasonXAI", una IA que ofrece decisiones interpretables, similares a las que proporcionaría un patólogo.

Mediante el uso de las llamadas "etiquetas blandas", que reflejan las incertidumbres entre las evaluaciones individuales de los patólogos, la IA fue capaz de lograr resultados reproducibles a pesar de la alta variabilidad. En una comparación directa con los modelos convencionales, GleasonXAI logró una precisión equivalente o superior, al tiempo que ofrecía una mayor transparencia.

La IA habla el idioma de los patólogos

En el estudio participaron patólogos de Alemania, EE.UU., Canadá, Suiza y otros países. Los expertos aportaron al proyecto una media de 15 años de experiencia clínica. Además de desarrollar el modelo, el equipo también está publicando el mayor conjunto de datos de libre acceso hasta la fecha con anotaciones explicativas de los patrones de Gleason con el fin de seguir avanzando en la investigación sobre IA explicable.

"Por primera vez, hemos desarrollado un sistema de IA que reconoce los rasgos tisulares característicos de los patrones de Gleason y los explica de forma similar a un patólogo", afirma Gesa Mittmann, coautora del estudio. "Esto debería aumentar la confianza y la aceptación de la IA en la práctica clínica diaria".

Potencial para la práctica clínica

Los resultados muestran que la IA explicable puede implementarse de forma práctica sin comprometer el rendimiento. Esto podría acelerar su uso en la patología rutinaria, lo cual es muy relevante, especialmente en tiempos de aumento de las tasas de cáncer y disminución de las capacidades de los especialistas.

Además, el modelo también permite la formación: "Las segmentaciones explicables pueden ayudar especialmente a los patólogos jóvenes a comprender patrones típicos y realizar diagnósticos fiables con mayor rapidez", subraya Brinker.

Nota: Este artículo ha sido traducido utilizando un sistema informático sin intervención humana. LUMITOS ofrece estas traducciones automáticas para presentar una gama más amplia de noticias de actualidad. Como este artículo ha sido traducido con traducción automática, es posible que contenga errores de vocabulario, sintaxis o gramática. El artículo original en Inglés se puede encontrar aquí.

Publicación original

Gesa Mittmann, Sara Laiouar-Pedari, Hendrik A. Mehrtens, Sarah Haggenmüller, Tabea-Clara Bucher, Tirtha Chanda, Nadine T. Gaisa, Mathias Wagner, ... Siamak Sakhaie, Michelle R. Downes, Hiroshi Miyamoto, Sean R. Williamson, Tim Holland-Letz, Christoph Wies, Carolin V. Schneider, Jakob Nikolas Kather, Yuri Tolkach, Titus J. Brinker; "Pathologist-like explainable AI for interpretable Gleason grading in prostate cancer"; Nature Communications, Volume 16, 2025-10-8